当地时间4月13日,斯坦福大学以人为本人工智能研究所(Stanford HAI)发布了《2026年人工智能指数报告》(Artificial Intelligence Index Report)。报告通过跨年度数据与多维度分析,勾勒出全球人工智能在技术、产业、科研、就业、治理及公众态度等领域的发展现状。

AI的抽象推理能力日益增强,但在物理常识方面仍存在明显短板

报告提出,2025年,业界开发了大量前沿模型,这些模型在多模态推理和竞赛数学等任务上已经达到甚至超过了人类水平。其中,代码能力的进步尤其明显。在编码测试SWE-bench Verified上,模型得分能力从2024年的约60%跳到了2025年的接近100%。

同时,AI智能体在真实电脑任务测试OSWorld里的准确率从12%左右涨到了66.3%,离人类基准只差约6个百分点。在网络安全测试Cybench上,无指导情况下的解决率从15%升到了93%。

推理能力的提升也很快。在专门为AI而设的“人类最后一次考试”中,模型的正确率一年内从不到10%提高到了38.3%。在博士级科学问答测试GPQA Diamond上,模型平均正确率达到93%,比人类专家81.2%的基准高了12个百分点。在国际数学奥林匹克里,Gemini Deep Think拿了35分,获得金牌,而前一年它只拿了28分(银牌)。

但抽象推理能力的飞跃与基础常识的短板形成了强烈反差。在ClockBench测试中,Gemini Deep Think对模拟时钟的正确读取率仅为50.1%,而人类的正确率则高达90.1%。研究还发现,模型经微调后能识别熟悉的钟面,但一旦换成真实照片或不同设计的钟面,就会难以应对。

中美并跑,人工智能主权成为各国新焦点

报告提出,中美AI模型的性能差距基本没了。从2025年初到2026年3月,两国的顶尖模型在Arena排行榜上多次交替领先。2025年2月,DeepSeek-R1一度追平美国最好的模型;到2026年3月,美国顶尖模型Claude Opus 4.6(1503分)仅领先中国顶尖模型Dola-Seed-2.0 Preview(1464 分)2.7个百分点。

报告提到,中美虽然在顶尖模型性能方面几乎没有差距了,但美国在私人投资、顶尖模型数量、高影响力专利以及芯片和算力基础设施上仍然有一些领先优势。2025年,美国发布了50个值得关注的AI模型,中国是30个。

但中国在2024年的AI论文总量(占全球17.8%)、论文引用份额(20.6%)、专利授权量(占全球74.2%)和工业机器人安装量(占全球54.4%)上都排在世界第一。还有一个值得注意的变化:从2017年起,搬到美国的AI研究人员和开发者数量下降了89%,光去年一年就降了80%。

另外,报告把“AI主权”列为2026年的一个核心概念。各国都在加紧建设自己能掌控的算力、数据、模型和应用体系。2018到2025年,欧洲和中亚的国有或公私合营AI超算集群从3个涨到了44个,北美涨到了41个;而南亚只有2个,中东和北非3个,拉美和加勒比8个。

投资呈爆发式增长,消费者价值愈发凸显

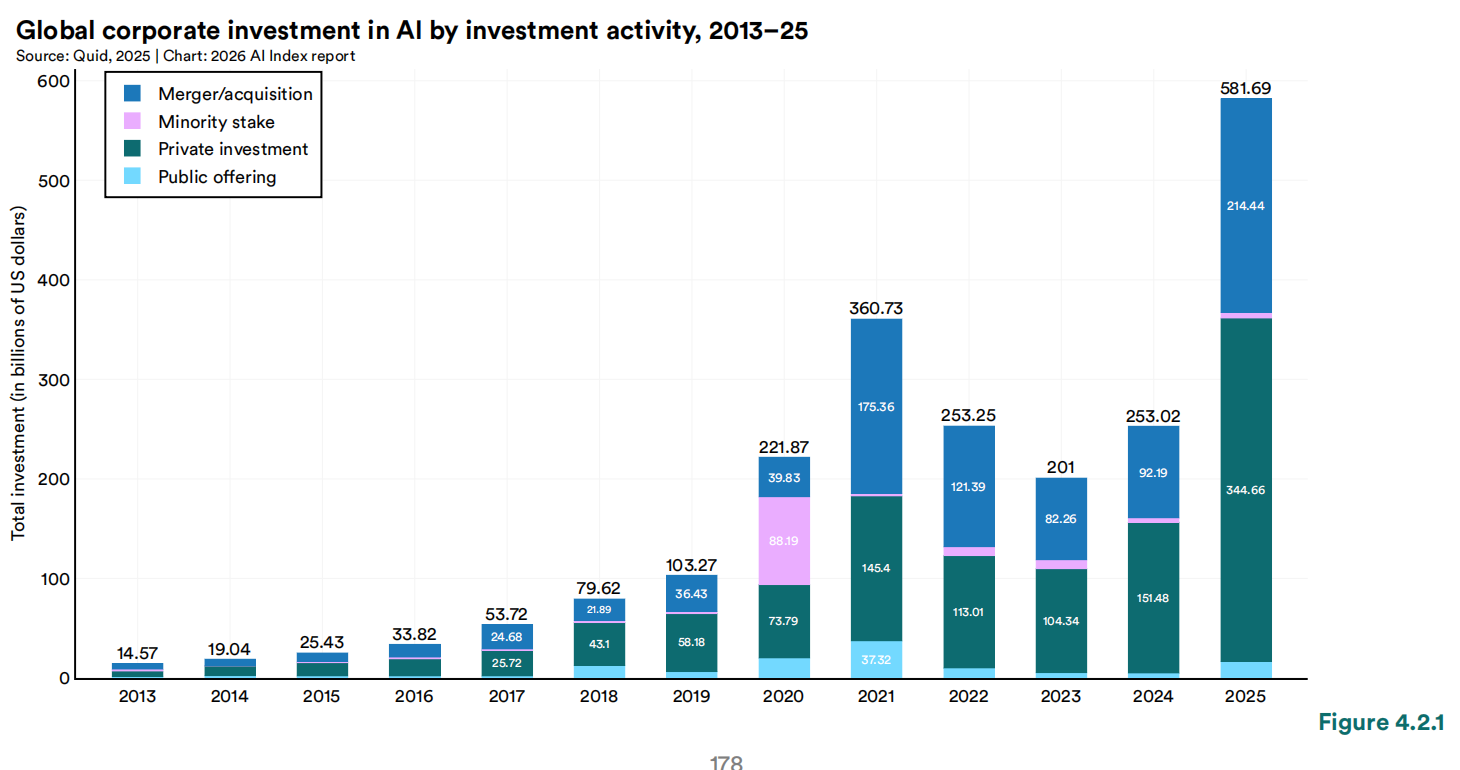

2025年,全球企业在AI上投入了5816.9亿美元,比前一年涨了129.9%。其中私人投资3446.6亿美元,涨了127.5%。其中,美国一家就投了2859亿美元。生成式AI获得了大约1709亿美元的私人投资,占了快一半,比2024年翻了两倍。

生成式AI的普及速度也是历史上前所未有的快,但报告提到,各国差别挺大,新加坡(61%)和阿联酋(54%)排在前头,美国只有28.3%,排在第24位。报告算了一笔账,预计到2026年生成式AI每年给美国消费者带来的价值大约1720亿美元,单个用户的中位价值一年里翻了两倍。这个消费者剩余远远超过生成式AI本身的收入,说白了就是“技术给社会带来的好处,远比公司自己赚的钱多”。

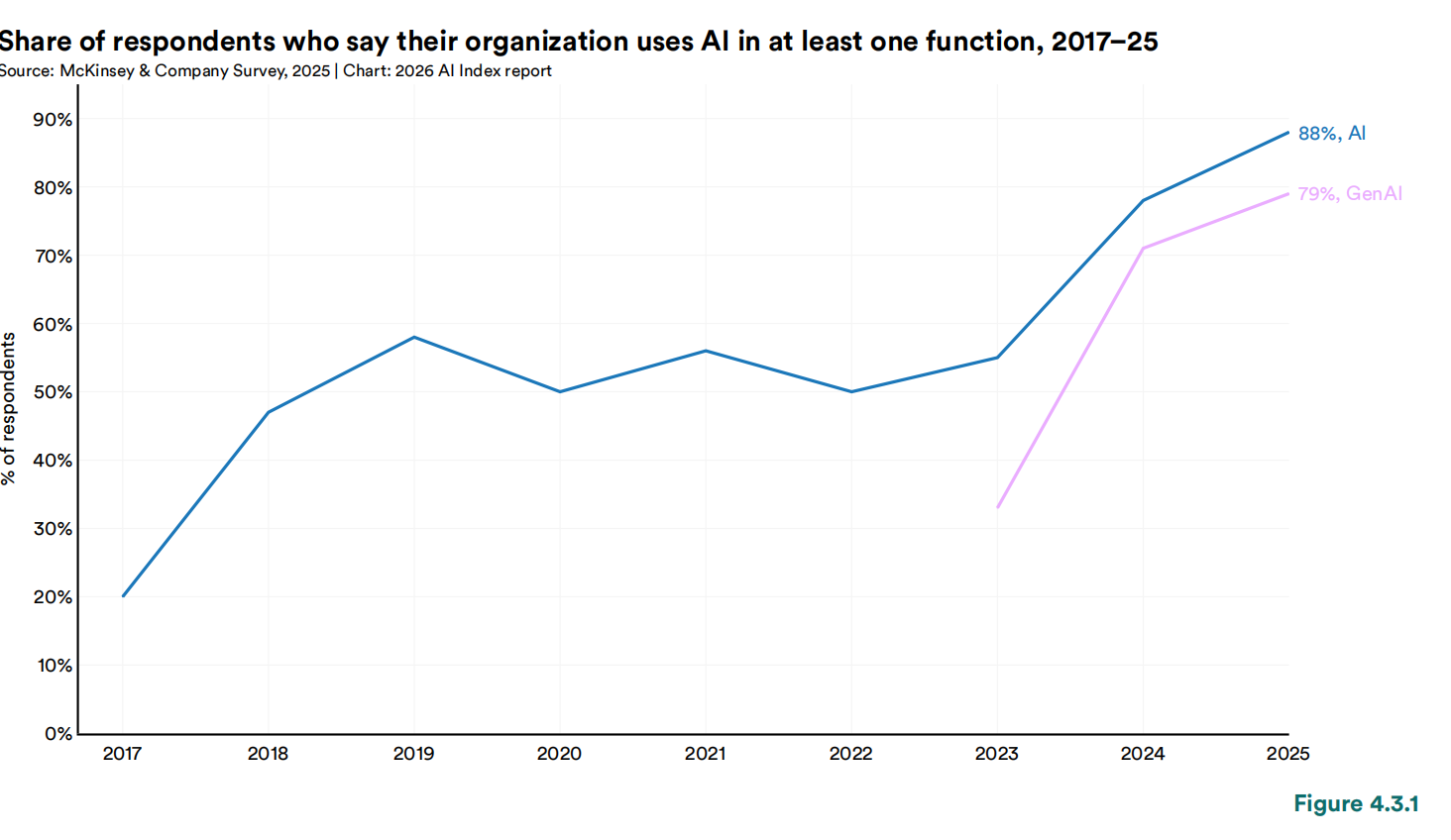

2025年,88%的被调查机构表示其所在机构在至少一个业务场景中使用了AI,这一比例比2024年的78%更高。但AI智能体的大规模落地还处于早期——大部分业务职能里,绝大多数组织压根没用上。安全风险是最大的拦路虎,62%的人把这列为头号障碍。

AI时代,年轻人先“挨一刀”,报告第一次用硬数据证明,AI对就业的冲击已经呈现出“年轻化”的特征。在美国,22到25岁的软件开发者,从2024年开始就业人数减少了将近20%。

企业调研显示,三分之一的受访者表示公司预期接下来一年会因AI进行裁员,而且几乎所有岗位预期的减员幅度都比已经发生的减员幅度要大。不过宏观失业数据倒是没那么极端。2022到2025年,所有职业的失业率都在涨,但AI暴露度最高的职业失业率只上涨了0.3个百分点,反而比暴露度最低的职业(涨了0.94个百分点)还低。

AI从“打杂的”升级为“科研伙伴”

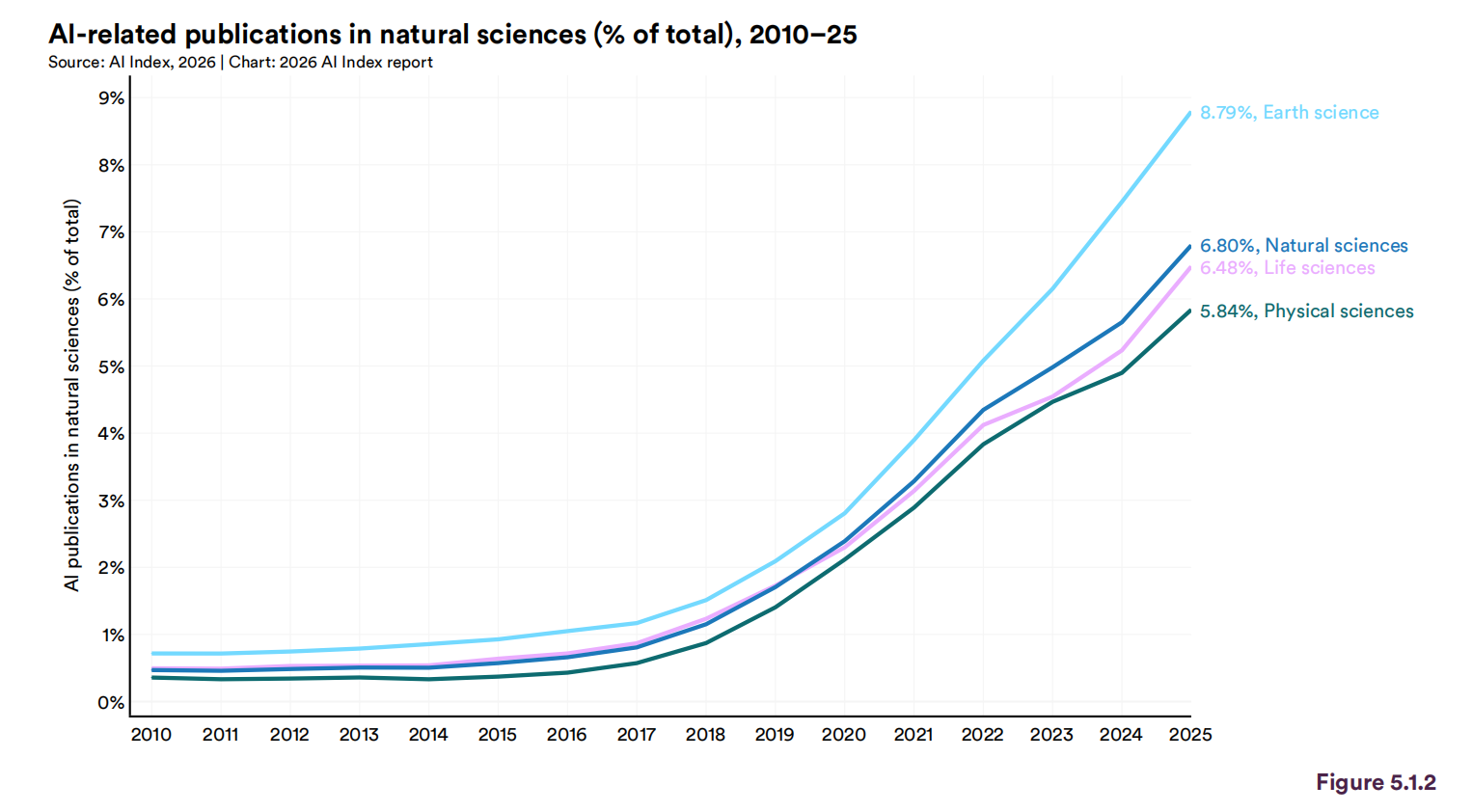

在Web of Science 数据库中,2025年,自然科学领域的AI相关论文有80150篇,比前一年多了26%。AI在地球科学、生命科学、物理科学中的产出占比分别达到了8.8%、6.5%和5.8%,而2010年这三个领域的相关论文数量占比均不到1%。

不过别高兴太早。让AI从头到尾做一整项科研任务,还差得远。PaperArena测试里,最好的AI智能体准确率只有38.8%,而博士专家的基准是83.5%。另一个生物信息学的测试BixBench上,前沿模型的正确率也就17%。这意味着AI在单个小任务上挺能打,但真让它在实际生物学研究中跑完整套流程,就暂时还没达到完全可用的程度。

既乐观又焦虑,信任也趋于分裂

全球59%的人觉得AI利大于弊(比2024年高了7个百分点),但同时52%的人对AI产品感到焦虑(高了2个百分点)。东南亚最乐观,中国、马来西亚、泰国、印度尼西亚、新加坡均超过80%的人认为未来3—5年AI会深刻改变生活。

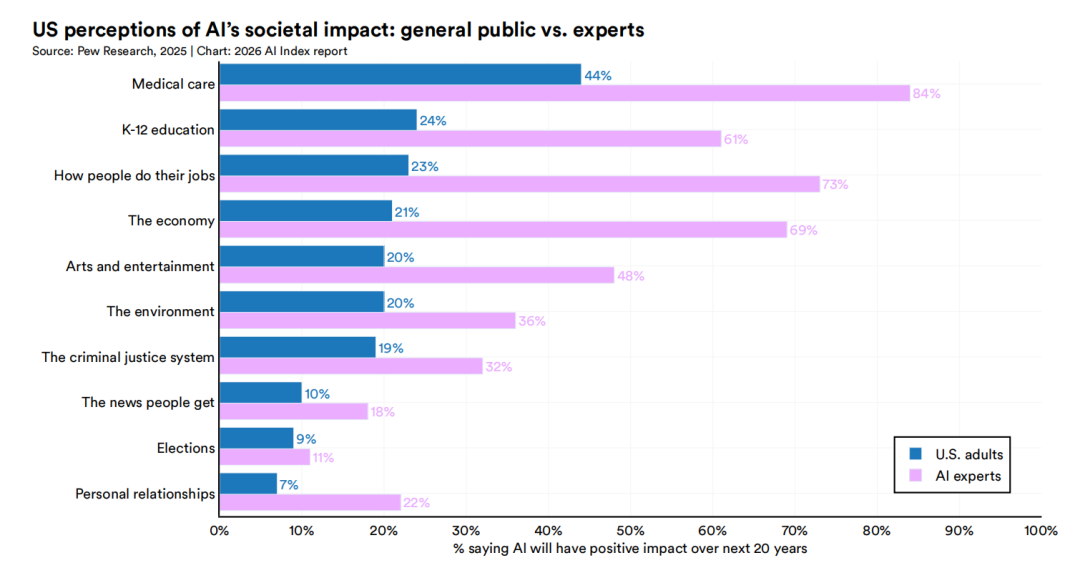

在美国,专家和普通人的看法差得很大。73%的AI专家觉得AI会对工作方式产生积极影响,但公众里只有23%这么看,差了50个百分点。经济(69%vs21%)和医疗(84%vs44%)也一样。

64%的美国公众认为20年内AI会让就业变少,专家里只有39%这么想。不过专家对速度的判断比公众激进得多,专家预测2030年生成式AI能辅助18%的美国工作时间,公众只猜10%。

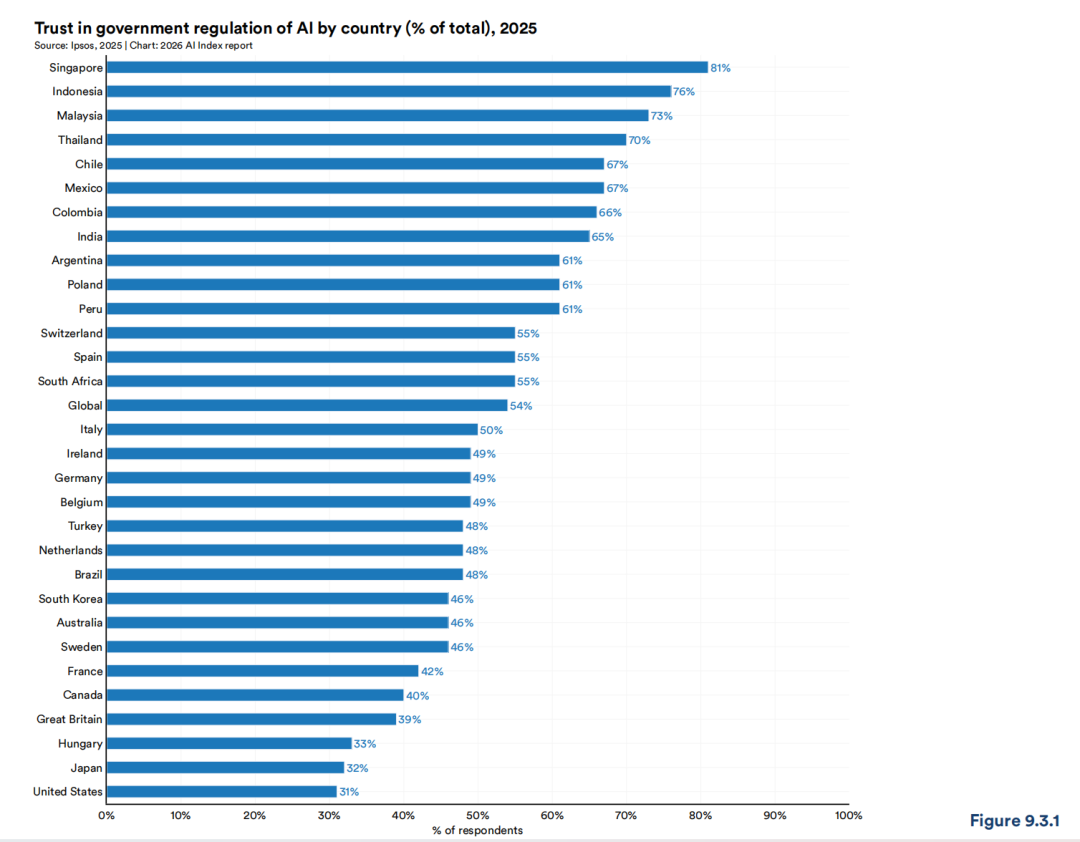

在信任这件事上,美国垫底。只有31%的美国公众信得过本国政府监管AI,全球平均水平是54%。新加坡(81%)、印尼(76%)、马来西亚(73%)、泰国(70%)排在前头。

结语

2026年不是AGI元年,而是AI从“能不能做”转向“做得怎么样、花多少钱、冒多大风险”的分水岭。行业不再只盯着遥远的通用智能,开始算成本、看落地、管风险、讲公平。对做企业、定政策、搞研究、干这行的人来说,以后不光要比谁模型强,更要比谁能在可控的成本和风险下,真正解决实际问题。

站在这个拐点上,真正的竞赛才刚刚开始——不只看谁跑得快,更看谁跑得稳、跑得久。

文章来源|斯坦福大学、互联网公开信息

赛博研究院

致力于成为面向数字经济时代的战略科技智库、服务数据要素市场的专业咨询机构和汇聚数智安全技术的协同创新平台。

© 2026. All Rights Reserved. 沪ICP备19027819号  沪公网安备31011002006159号

沪公网安备31011002006159号